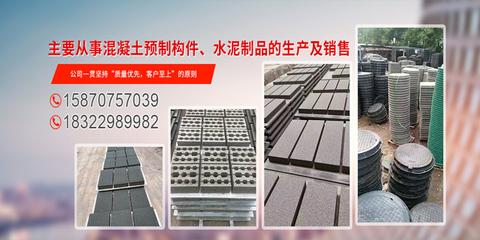

優質實心砌塊水泥卡盤 選購與使用指南

在建筑和基礎施工中,水泥卡盤作為一種關鍵的連接與固定配件,扮演著不可或缺的角色。實心砌塊水泥卡盤,憑借其出色的結構穩定性和耐久性,被廣泛應用于墻體砌筑、管道固定、設備安裝及各類混凝土結構工程中。如果您正在尋找可靠的水泥配件卡盤供應商,本指南將為您介紹其產品特性、選購要點及市場應用。

產品概述

實心砌塊水泥卡盤,通常由高標號混凝土或水泥基材料制成,具有實心結構,確保高強度與抗壓能力。這類卡盤設計用于穩固連接砌塊、固定管道或嵌入其他構件,常見形狀包括方形、圓形或定制幾何形態,表面可能經過處理以增強附著力或防腐蝕性能。作為水泥制品的一種,它與混凝土結構兼容性好,能有效提升整體工程的穩定性和使用壽命。

主要特點與優勢

- 高強度與耐久性:實心結構使卡盤能承受重載和長期應力,適用于戶外或惡劣環境。

- 廣泛應用:可用于建筑砌體、市政工程、電力設施、農業設備等多種場景。

- 易于安裝:標準化設計簡化施工流程,節省時間和人力成本。

- 經濟實惠:水泥基材料成本相對較低,性價比高,適合大規模采購。

- 環保安全:采用無機材料,無有害物質釋放,符合綠色建筑趨勢。

選購指南

當您從廠家采購時,需關注以下幾點:

- 材質與規格:確認水泥標號、密度及尺寸是否符合工程要求;標準規格包括不同直徑和厚度選項。

- 質量認證:選擇通過行業標準檢測(如國家標準GB/T)的產品,確保性能可靠。

- 廠家信譽:優先考慮有多年生產經驗、提供質檢報告的供應商,可通過客戶評價或案例參考評估。

- 定制服務:如需特殊形狀或功能,詢問廠家是否支持定制生產,以滿足個性化需求。

- 價格與物流:比較多家報價,考慮批量采購折扣,并確認配送范圍及交貨時間。

市場應用案例

實心砌塊水泥卡盤在以下領域表現突出:

- 建筑工程:用于磚墻或混凝土砌塊的加固,提高抗震性能。

- 基礎設施:在管道系統中作為支撐卡盤,防止位移或泄漏。

- 工業設備:固定機械底座,減少振動和磨損。

- 農業與園藝:搭建溫室或圍欄時提供穩定連接點。

銷售與售后建議

作為廠家或銷售方,可強調產品的質量保證、及時供貨及技術支援。提供樣品測試、安裝指導或售后維護服務,能增強客戶信任。隨著綠色建筑理念普及,推廣水泥制品的可回收性和低碳特性,可吸引更多環保意識強的客戶。

實心砌塊水泥卡盤是工程中實用且經濟的配件選擇。通過合理選購和正確使用,它能顯著提升項目質量與安全性。如果您有采購需求,建議直接聯系專業廠家獲取詳細產品目錄和報價,以確保獲得最適合的解決方案。

如若轉載,請注明出處:http://m.8pxu3n.cn/product/56.html

更新時間:2026-05-30 13:45:59